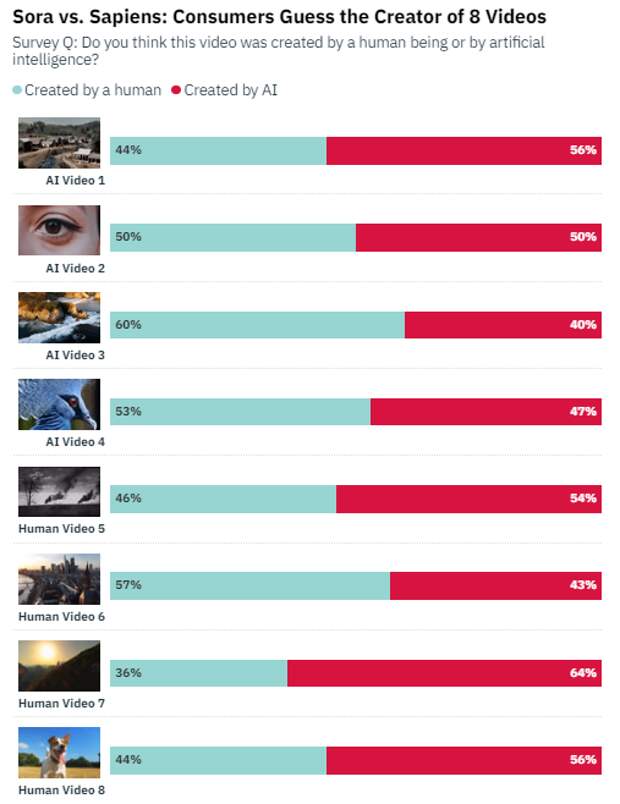

Опрос проводила компания HarrisX, которая занимается маркетинговыми исследованиями. Она предложила респондентам указать, какие из 8 видео были созданы людьми, а какие сгенерированы ИИ. Участники опроса постоянно ошибались, причём работало это в обе стороны: человеческие произведения принимали за подделки и наоборот.

Большинство респондентов сообщило, что развитие ИИ не вызывает у них негативных чувств. 28% указали, что реалистичные ИИ-видео вызывают у них любопытство, 25% сообщили, что открыты новым технологиям, а 18% испытали воодушевление. Страх почувствовали только 2% участников, но на тревогу пожаловались 18%.

Интересно, что большинство опрошенных считают, что сфере ИИ-видео нужно жёсткое законодательное регулирование. Причём без разницы, положительно или отрицательно они относятся к технологии: респондентов всё равно пугает возможность создания дипфейков. Например, можно сгенерировать видео, на котором человек совершает преступление, а затем наложить на него нужное лицо. Суд, скорее всего, сможет отличить такое «доказательство» от истины, но широкая общественность — нет. Особенно если показать его по телевизору, без возможности перемотать обратно и изучить внимательно. Политики в США опасаются, что в будущем это может дестабилизировать страну перед выборами.

Сейчас Sora ещё недоступна широкой публике, но уже вызывает тревогу среди политиков, создателей контента и работников индустрии фильмов. Эта нейросеть от OpenAI генерирует минутные видео из текстовых подсказок. Их главная особенность — высокая реfлистичность, которая приводит зрителей в замешательство.

Верить своим глазам уже нельзя — происходящее на экране может оказаться не реальной записью, а умелой подделкой.Не всегда видео идеальны, но подвох заметить трудно. Например, журналисты продемонстрировали

, где человек играет с кошкой. На первый взгляд всё кажется нормальным, но на несколько секунд у животного появляется третья передняя лапа.

Свежие комментарии